ChatGPT之父等350余位专家高管联名警告:AI堪比疫情和核战,有灭绝人类的风险

(观察者网讯)“人工智能或导致人类灭绝”,5月30日,国际AI领域非营利组织“人工智能安全中心”(Center for AI Safety)发布公开信,呼吁国际社会认真对待人工智能带来的一系列重要且紧迫的风险。

公开信截图(下同)

这封公开信中,只有由22个英文单词组成的简短的一句话:

“减轻人工智能带来的人类灭绝风险,应该与大流行病和核战争等其他影响社会的大规模风险一同成为全球性的优先事项。”

根据“人工智能安全中心”网站发布信息,截至5月30日,该公开信已获得研究AI工作的企业高管以及AI、气候、传染病等各领域教授和学者,总计超350人的签署。

签署人包括三家全球顶尖AI公司的CEO——“ChatGPT之父”、OpenAI创始人兼CEO萨姆·阿尔特曼,谷歌DeepMind公司CEO戴米斯·哈萨比斯,以及美国Anthropic公司的CEO达里奥·阿莫代伊。微软和谷歌公司的多名高管也在名单之中。

名单中,杰弗里·辛顿(Geoffrey Hinton)和约书亚·本吉奥(Yoshua Bengio)的名字赫然在列。美媒《纽约时报》称,辛顿和本吉奥是被世人誉为三名“AI教父”中的两人,曾因在神经网络方面的开创性工作而获得计算机领域最高奖项——图灵奖。

“AI教父”中的第三人、现任脸书母公司Meta的首席AI科学家的伊恩·勒坤(Yann LeCun)尚未签名。

此外,签署人名单中也不乏人工智能领域的著名学者和高校教授,其中包括中国工程院院士、清华大学智能产业研究院(AIR)院长张亚勤,中国科学院自动化研究所人工智能伦理与治理研究中心主任曾毅,以及清华智能产业研究院助理研究员詹仙园。

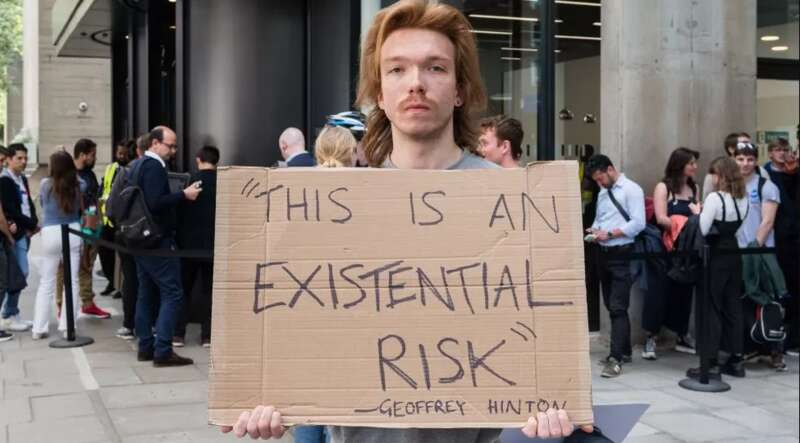

抗议者在伦敦呼吁对人工智能进行监管,图自BBC

“这代表了人工智能专家组成的历史性联盟,和哲学家、伦理学家、法律学者、经济学家、物理学家、政治学家、流行病学家、核科学家和气候科学家一同,将人工智能系统带来的人类灭绝风险确定为世界上最重要的问题。”在同日发表的另一份声明中,“人工智能安全中心”如此写道。

声明还称,获得超350名专家、学者和高管联名的公开信肯定了目前日益增长的公众情绪。路透社和民调机构“益普索”近日进行的一项民调结果显示,有61%的美国受访者认为人工智能威胁着人类的未来。

“人工智能安全中心”丹·亨德里克斯表示,解决全世界现已感受到的人工智能负面影响至关重要,同时国际社会还应有先见之明,“设置护栏”,预测更先进的人工智能系统将带来的风险,“这样才不会有朝一日措手不及”。

路透社提到,这封公开信发出呼吁之际,恰逢美国-欧盟贸易和技术委员会在瑞典举行会议。

自去年11月底面世至今,ChatGPT便不断引起争议。作为AlphaGo之后又一个基于人工智能技术的现象级应用,ChatGPT颠覆了公众对聊天机器人的认知,也再次唤醒了人类对人工智能的担忧。

今年3月,另一个国际AI领域非营利组织“未来生命研究所”以公开信的方式发起倡议,呼吁所有人工智能实验室立即暂停训练比GPT-4更强大的AI系统至少6个月。截至3月29日下午,公开信获得了包括马斯克在内的超1000名科技界人士的联名签署。

另据《纽约时报》报道,本月早些时候,三家全球顶尖AI公司的CEO阿尔特曼、哈萨比斯和阿莫迪曾前往白宫会见拜登和哈里斯,讨论人工智能监管问题。在会后的参议院证词中,阿尔特曼警告说,先进人工智能系统所带来的风险,已严重到需要保证政府干预。

人工智能三阶段:为何科学家联署限制可导致人类灭绝的AI技术

图像来源,GETTY IMAGES

包括OpenAI和谷歌Deepmind负责人在内的专家警告,人工智能可能导致人类灭绝,但是机器如何取代人类呢?

自2022年11月推出以来,ChatGPT——一款使用人工智能根据用户的需求回答问题或生成文本甚至代码的聊天机器人,已经成为历史上增长最快的互联网应用程序。

在仅两个月的时间里,它的活跃用户达到了1亿。据科技监测公司Sensor Town称,Instagram花了两年半的时间才达到这一里程碑。

图像来源,REUTERS

图像加注文字,ChatGPT应用程序的出现引发了关于如何确保人工智能安全的激烈争论。

OpenAI公司在微软的资助下开发的ChatGPT广受欢迎,引发了人们对人工智能影响人类未来的激烈猜测。

数十名专家支持在人工智能安全中心(Center for AI Safety)网页上发表的一份声明,称:“减轻人工智能造成的灭绝风险,应该与流行病和核战争等其他社会规模的风险一起成为全球优先事项。”

但也有人表示,这种担忧被夸大了。

图像来源,GETTY IMAGES

模仿人类

ChatGPT、DALL-E、Bard和AlphaCode等人工智能产出的文本(从散文、诗歌和笑话到计算机代码)和图像(如图表、照片和艺术品),几乎与人类自己的作品一模一样,难以区分。

学生们用它来写作业,政客们用它来写演讲稿。民主党众议员杰克·奥金克洛斯(Jake Auchincloss)在美国国会推出了这一资源。

科技巨头IBM称,将停止招聘7800个可以由人工智能处理的岗位。

如果所有这些变化让你不知所措,那就做好准备:

图像来源,GETTY IMAGES

图像加注文字,人工智能越先进,就越有能力取代我们的工作。

我们还只是处于人工智能的第一阶段,还有两个阶段即将到来,一些科学家害怕这可能会威胁到人类的生存。

以下是三个阶段。

1. 弱人工智能(Artificial Narrow Intelligence)

弱人工智能也被称为限制领域人工智能,专注于单一任务,在一系列功能中执行重复性工作。

它通常从大量数据中学习,比如从互联网上学习,但只在它被编程的特定领域学习。

一个例子是象棋程序,能够击败世界冠军,但无法执行其他任务。

图像来源,GETTY IMAGES

图像加注文字,弱人工智能可以超越人类,但只在特定领域。

智能手机上到处都是使用这种技术的应用程序,从GPS地图,到了解你的口味并提出建议的音乐和视频程序。

甚至更复杂的系统,如无人驾驶汽车和ChatGPT,都是弱人工智能的形式。他们不能在设定的角色范围之外运作,所以不能靠自己做决定。

但一些专家认为,被编程为具有自动学习功能的系统,如ChatGPT或AutoGPT,可能会进入下一个发展阶段。

图像来源,GETTY IMAGES

图像加注文字,2023年5月27日,中国广东省深圳的ChatGPT应用下载界面。

2. 人工通用智能(Artificial General Intelligence)

当机器能够完成人类所能完成的任何智力任务时,人工通用智能(Artificial General Intelligence)就将到来。

图像来源,GETTY IMAGES

图像加注文字,通用人工智能是指机器拥有与人类相同的智力能力。

它也被称为“强人工智能”。

6个月的暂停

2023年3月,1000多名技术专家呼吁“所有人工智能实验室立即暂停至少6个月的比GPT-4更强大的人工智能系统的训练”,GPT-4是ChatGPT的最新版本。

包括苹果联合创始人斯蒂夫·沃兹尼亚克以及包括特斯拉和SpaceX公司老板埃隆·马斯克在内的其他科技巨头写道:“具有与人类竞争智力的人工智能系统可能对社会和人类构成深刻的风险。”马斯克曾是OpenAI的联合创始人之一,后来因与公司领导层意见不合而辞去了董事会职务。

图像来源,GETTY IMAGES

在这封由非营利机构“生命未来研究所”(Future of Life Institute)发布的信中,专家们表示,如果公司拒绝迅速停止它们的项目,“政府应该介入并实施暂停令”,以便设计和实施安全措施。

“既聪明又愚蠢”

牛津大学人工智能伦理研究所的卡丽莎·韦丽兹(Carissa Véliz)在这封信上签了名。但她认为,人工智能安全中心后来发布的警告灭绝的声明太过了,因此决定不签署。

“我们目前正在开发的这种人工智能既聪明又愚蠢,”她告诉BBC的安德鲁·韦伯(Andrew Webb),“如果有人尝试过ChatGPT或其他人工智能,他们会注意到它们有非常显著的局限性。”

韦丽兹表示,她担心人工智能会以极高的速度制造错误信息。

“随着2024年美国大选临近,像推特和其他重要平台解雇了他们的人工智能道德和安全团队,我更担心这一点。”

图像来源,GETTY IMAGES

美国政府承认潜在的威胁。白宫在5月4日的一份声明中称:“人工智能是我们这个时代最强大的技术之一,但为了抓住它带来的机遇,我们必须先降低它的风险。”

美国国会曾传唤OpenAI首席执行官山姆·阿尔特曼(Sam Altman)回答有关ChatGPT的问题。

图像来源,GETTY IMAGES

图像加注文字,山姆·阿尔特曼

在参议院听证会上,阿尔特曼表示,随着人工智能的发展,政府对他的行业进行监管是“非常重要的”。

生命未来研究所的公共政策研究员古铁雷斯(Carlos Ignacio Gutiérrez)对BBC解释,人工智能带来的巨大挑战之一是,“没有一个由专家组成的联合机构来决定如何监管它,就像政府间气候变化专门委员会(IPCC)那样。”

这就把我们带到了人工智能的第三个也是最后一个阶段。

3. 超人工智能

图像来源,GETTY IMAGES

这是一种理论,当我们到达第二阶段时,我们将很快进入最后阶段:“超人工智能”。当人工智能超过人类智能时,就会出现这种情况。

牛津大学哲学家、人工智能专家博斯特罗姆(Nick Bostrom)将超智能定义为“在几乎所有领域,包括科学创造力、一般智慧和社交技能,都远远超过最优秀的人类大脑的智能”。

“人类要成为工程师、护士或律师,必须学习很长时间。通用人工智能的问题在于……它可以在我们做不到的时候不断改进自己,”古铁雷斯解释说。

科幻小说

这个概念让人想起了电影《终结者》的情节,在这部电影中,机器发动了一场毁灭人类的核战争。

图像来源,GETTY IMAGES

图像加注文字,施瓦辛格曾出演《终结者》。

普林斯顿大学的计算机科学家纳拉亚南(Arvind Narayanan)此前曾告诉BBC,科幻般的灾难场景是不现实的:“目前的人工智能还远远不足以让这些风险成为现实。最后,它分散了人们对人工智能短期危害的注意力。”

虽然对于机器是否真的能获得人类拥有的那种广泛的智能,尤其是在情商方面,存在很多争论,但这是那些认为我们即将实现通用人工智能的人最担心的事情之一。

最近,所谓的“人工智能教父”杰弗里·欣顿(Geoffrey Hinton)警告,我们可能即将达到这一里程碑。欣顿是教授机器从经验中学习的先驱。

“我认为,现在(机器)并不比我们聪明。但我认为他们可能很快就会这样,”他刚刚从谷歌退休,今年75岁。

图像来源,REUTERS

图像加注文字,”人工智能教父”杰弗里·欣顿

欣顿在发给《纽约时报》的一份宣布离开谷歌的声明中表示,他现在对自己所做的工作感到后悔,因为他担心“糟糕的参与者”会利用人工智能做“坏事”。

他给BBC举了一个“噩梦场景”一般的例子:“想象一下,例如,像(俄罗斯总统)普京这样的糟糕参与者决定赋予机器人能力,创造自己的子目标。”

他警告说,这些机器最终可能会“创造出‘我需要更多权力’这样的子目标”,这将带来“生存风险”。

但欣顿表示,在短期内,他认为人工智能带来的好处要比风险大得多,“所以我认为我们不应该停止开发这种东西。”他说。

灭绝还是不朽

英国物理学家斯蒂芬·霍金发出过严厉的警告。

图像来源,GETTY IMAGES

图像加注文字,霍金

“人工智能的全面发展可能意味着人类的终结,”他在2014年告诉BBC,也就是他去世前四年。

他说,具有这种智能水平的机器“将自行发展,并以越来越快的速度重新设计自己”。

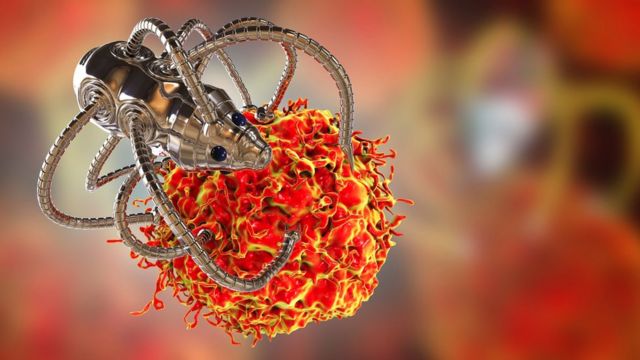

纳米机器人与永生

未来主义发明家兼作家库兹韦尔(Ray Kurzweil)是人工智能的最大爱好者之一,他是谷歌的人工智能研究员,也是硅谷奇点大学的联合创始人。

库兹韦尔认为,人类将能够使用超级智能的人工智能来克服生物障碍。

2015年,他预测,到2030年,因为纳米机器人(非常小的机器人)在我们体内工作,能够修复和治愈任何损伤或疾病,人类将实现永生。

图像来源,GETTY IMAGES

图像加注文字,纳米机器人能让人类长寿或长生不老吗?

人工智能管理

古铁雷斯同意,关键是要创建一个人工智能治理系统。

“想象一下这样的未来:一个实体拥有地球上每个人及其习惯的大量信息(因为互联网搜索),它可以用我们无法意识到的方式控制我们。”他说。

“最糟糕的场景并不是人类与机器人之间的战争。最糟糕的是,我们没有意识到自己被操纵了,因为我们与一个比我们聪明得多的实体分享这个星球。”